Gouvernance de l’IA : allier innovation et conformité

Cet article souligne l'importance d'une gouvernance rigoureuse pour l'intelligence artificielle (IA) dans les entreprises. L'IA offre des opportunités majeures mais nécessite un cadre réglementaire strict pour éviter les dérives éthiques et juridiques.

Introduction – L’IA, entre opportunité stratégique et défi réglementaire

L’intelligence artificielle s’impose comme un levier majeur de transformation pour les entreprises. Automatisation, personnalisation, aide à la décision, analyse prédictive… ses promesses sont nombreuses et les cas d’usage se multiplient. Pour rester compétitives, les organisations explorent activement l’intégration de l’IA dans leurs processus métiers, produits ou services.

Mais derrière l’enthousiasme, une réalité s’impose : l’IA ne peut plus être déployée sans cadre. En parallèle de son essor technologique, elle soulève des enjeux complexes — éthiques, juridiques, opérationnels — que les entreprises ne peuvent plus ignorer. Faut-il avoir le droit d’utiliser telle donnée ? Peut-on automatiser telle décision ? Que faire si un biais algorithmique impacte un client ou un collaborateur ?

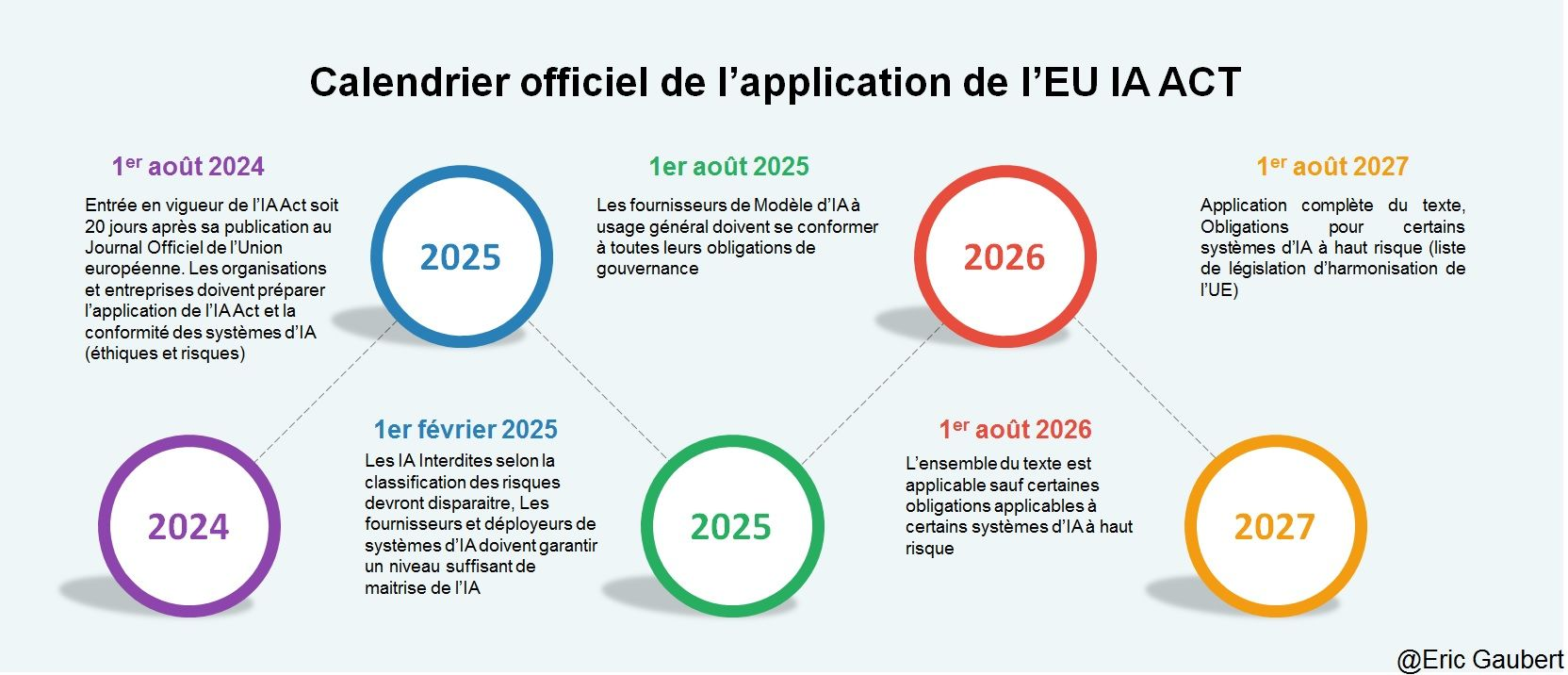

Les autorités réglementaires, notamment en Europe, ont répondu en instaurant des cadres de plus en plus précis, comme le RGPD et le très attendu IA Act avec une application de toutes les dispositions à partir du 2 août 2026. Ces textes imposent une gouvernance claire : intégrer l’IA ne suffit pas, encore faut-il le faire de manière responsable, sécurisée et conforme.

C’est dans ce contexte que la gouvernance de l’IA devient un enjeu central. Elle ne se limite pas à un sujet technique ou juridique : c’est un sujet stratégique, qui engage l’ensemble de l’entreprise. Et bien menée, elle peut transformer la contrainte réglementaire en avantage compétitif.

Gouvernance de l’IA : de quoi parle-t-on ?

L’IA n’est pas un outil classique. Elle apprend, évolue, prend des décisions, influence des comportements. C’est précisément cette capacité à agir de manière autonome ou semi-autonome qui oblige les entreprises à mettre en place une gouvernance dédiée.

La gouvernance de l’IA, c’est la manière dont une organisation encadre, contrôle et pilote l’usage de ses systèmes d’intelligence artificielle, du développement jusqu’au déploiement opérationnel. Elle vise à s’assurer que ces technologies sont utilisées de manière responsable, transparente, sécurisée, et en conformité avec la réglementation en vigueur.

Pourquoi une gouvernance spécifique ?

L’IA pose des problématiques nouvelles que les structures de gouvernance traditionnelles ne couvrent pas toujours :

- Un algorithme peut évoluer avec le temps (systèmes apprenants), ce qui rend le comportement final difficile à prévoir si aucun contrôle n’est mis en place.

- Les décisions automatisées peuvent être biaisées, discriminatoires ou opaques, ce qui expose l’entreprise à des risques juridiques et réputationnels.

- La responsabilité en cas d’erreur est floue : est-ce le développeur ? L’utilisateur métier ? L’entreprise qui fournit le modèle ?

Ces enjeux exigent une gouvernance claire, adaptée à la complexité des systèmes d’IA.

Les piliers de la gouvernance de l’IA

Voici les grandes dimensions à structurer dans une stratégie de gouvernance :

- Transparence :Une IA ne peut pas être une boîte noire. Il faut être capable d’expliquer comment un algorithme fonctionne, quelles données il utilise, comment ses décisions sont prises. Cela ne signifie pas tout divulguer, mais offrir un niveau d’explicabilité suffisant, surtout pour les cas à fort impact (ex : notation de crédit, tri de candidatures, diagnostic médical).

- Responsabilité :Chaque système d’IA doit avoir des responsables identifiés : pour sa conception, son déploiement, sa supervision. Il est aussi crucial de documenter les décisions humaines liées à son utilisation. La gouvernance clarifie qui valide les usages, qui arbitre les risques, et qui rend des comptes en cas de problème.

- Conformité :La réglementation devient de plus en plus stricte en matière d’IA. Le RGPD impose déjà des obligations en cas de traitement automatisé de données personnelles. L’IA Act européen vient ajouter un cadre complet, basé sur les niveaux de risques. Une bonne gouvernance doit anticiper ces contraintes et les intégrer dans le cycle de vie des projets IA.

- Éthique :Même sans texte de loi, certaines pratiques doivent être évitées : surveillance intrusive, traitement inégalitaire, manipulation des comportements… L’éthique complète la conformité légale en posant des limites alignées avec les valeurs de l’entreprise.

À quoi ressemble une gouvernance bien mise en place ?

Prenons un exemple : une entreprise de services financiers souhaite utiliser l’IA pour automatiser l’analyse de demandes de crédit.

- Elle commence par cartographier les données utilisées (revenus, situation pro, historique bancaire) et vérifie leur sensibilité.

- Elle définit un référent métier et un référent technique pour suivre le projet.

- Elle documente les règles de décision du modèle (quelles variables pèsent le plus).

- Elle vérifie que le modèle n’introduit pas de discrimination indirecte (ex : en défavorisant certains codes postaux).

- Elle met en place un comité de validation avant mise en production, puis un dispositif de supervision continue.

- Et surtout, elle informe les clients qu’une IA intervient dans le processus, avec la possibilité de demander une révision humaine.

C’est ça, une gouvernance d’IA appliquée et efficace : cadrée, structurée et documentée.

L’IA Act : ce que les entreprises doivent savoir

L’IA Act, ou règlement européen sur l’intelligence artificielle, est le premier cadre juridique d’ampleur à viser spécifiquement les systèmes d’IA. Adopté par l’Union européenne début 2024, il entrera en vigueur progressivement à partir de 2025. Son objectif est clair : encadrer les usages de l’IA en fonction de leur niveau de risque, pour garantir la sécurité, les droits fondamentaux et la confiance du public.

Pour les entreprises, l’IA Act change la donne : il ne s’agit plus seulement de suivre des recommandations éthiques, mais de respecter un cadre légal contraignant. Voici ce qu’il faut retenir.

Un cadre basé sur les niveaux de risque

L’IA Act classe les systèmes d’IA en quatre catégories de risque, avec des obligations qui varient fortement selon le niveau :

- Risque inacceptable – Interdiction pure et simple

Certains usages de l’IA sont jugés incompatibles avec les valeurs européennes. Exemples :- Notation sociale par les autorités publiques (type "social credit score" chinois)

- Manipulation cognitive exploitant des vulnérabilités (ex : jouets incitant les enfants à se comporter dangereusement)

- Surveillance biométrique de masse en temps réel dans l’espace public (sauf exceptions)

- Risque élevé – Fortement réglementé

C’est la catégorie qui impacte le plus les entreprises. Sont visés ici les systèmes qui ont un impact significatif sur les droits ou la sécurité des personnes :Pour ces systèmes, l’entreprise doit respecter des obligations strictes :- Recrutement ou tri de candidatures

- Attribution de crédit ou d’aides sociales

- Diagnostic médical

- Évaluation des élèves

- IA dans des dispositifs critiques (transports, sécurité industrielle…)

- Documentation technique complète

- Gestion des données d’entraînement

- Évaluation de la qualité et de la robustesse

- Enregistrement dans une base européenne

- Supervision humaine

- Transparence vis-à-vis des utilisateurs

- Risque limité – Obligations de transparenceCela concerne par exemple les chatbots ou les générateurs d’images IA. Il faut simplement informer clairement les utilisateurs qu’ils interagissent avec une IA.

- Risque minimal ou nul – Libre utilisationLes systèmes d’IA sans impact direct sur les droits des individus (comme un moteur de recommandation interne ou une IA d’optimisation énergétique) ne sont soumis à aucune contrainte particulière, mais restent concernés par le RGPD si des données personnelles sont traitées.

Qui est concerné ?

Le champ d’application de l’IA Act est extrêmement large. Il concerne :

- Les développeurs de systèmes d’IA (fournisseurs)

- Les entreprises qui intègrent ou exploitent des IA dans leurs services ou produits (utilisateurs professionnels)

- Les importateurs et distributeurs d’IA sur le marché européen, même si le modèle vient d’un pays tiers

En clair, même une entreprise française qui utilise une IA achetée à l’étranger pour trier des CV devra se conformer à l’IA Act si l’usage est considéré comme à haut risque.

Quels sont les risques en cas de non-conformité ?

Les sanctions prévues sont significatives :

- Jusqu’à 35 millions d’euros ou 7 % du chiffre d’affaires mondial pour les infractions les plus graves (comme l’usage d’une IA interdite)

- Sanctions moindres mais toujours importantes pour le non-respect des obligations sur les systèmes à haut risque

Au-delà des amendes, c’est la perte de confiance, le blocage de projets IA, ou l’impossibilité de les commercialiser en Europe qui constituent les vrais risques.

Que faire maintenant ?

Même si toutes les obligations ne s’appliquent pas immédiatement, les entreprises ont intérêt à anticiper dès maintenant :

- Identifier les cas d’usage IA en cours ou à venir

- Évaluer leur niveau de risque selon l’IA Act

- Documenter les modèles utilisés et les jeux de données

- Mettre en place des procédures de validation, de supervision et de transparence

Les entreprises qui s’organisent dès aujourd’hui auront un temps d’avance stratégique, tandis que les autres risquent d’être freinées ou exposées à des blocages réglementaires.

RGPD et IA : un duo indissociable

Le RGPD (Règlement Général sur la Protection des Données), en vigueur depuis 2018, est souvent considéré comme une contrainte pour les projets d’IA. En réalité, il pose les bases d’un usage plus responsable, plus transparent, et donc plus durable de la donnée — le carburant essentiel de l’intelligence artificielle.

Si votre entreprise développe ou utilise une IA qui traite des données personnelles (nom, voix, image, comportement, etc.), alors le RGPD s’applique pleinement, même si l’IA Act ne s’applique pas encore. C’est souvent le cas : une IA qui trie des CV, personnalise des offres, recommande du contenu ou analyse des comportements clients entre dans ce champ.

Voici les principes du RGPD à prendre en compte dans tout projet d’IA.

Une base légale est obligatoire

Aucune IA ne peut traiter des données personnelles sans fondement juridique clair. Le RGPD prévoit six bases légales : consentement, contrat, obligation légale, intérêt vital, mission d’intérêt public et intérêt légitime.

Dans le cas de l’IA :

- Le consentement explicite est souvent requis, surtout si l’IA a un impact significatif (profilage, scoring, etc.).

- L’intérêt légitime peut parfois être utilisé, mais il nécessite une analyse d’équilibre entre les intérêts de l’entreprise et les droits des personnes.

Transparence et information des personnes concernées

Le RGPD impose d’informer les individus de manière claire, accessible et compréhensible :

- Que leurs données sont traitées

- À quelles fins

- Par quel type de technologie (ici, une IA)

- Quels sont leurs droits

- Et comment demander une intervention humaine si une décision automatisée les affecte

Ce point est crucial dans les projets d’IA : il faut rendre visible l’invisible. Même si l’algorithme est complexe, l’explication à l’utilisateur doit rester intelligible.

Droits renforcés en cas de décisions automatisées

L’article 22 du RGPD donne aux personnes le droit de ne pas faire l’objet d’une décision fondée uniquement sur un traitement automatisé (y compris le profilage), qui produit des effets juridiques ou significatifs à leur égard.

Cela signifie que :

- L’IA ne peut pas, seule, rejeter un crédit ou refuser une candidature sans qu’un humain puisse intervenir.

- L’entreprise doit être en mesure de justifier la décision.

- L’utilisateur doit pouvoir contester cette décision et demander une réévaluation humaine.

Minimisation, sécurité, et durée de conservation

Les projets d’IA doivent aussi respecter les autres principes clés du RGPD :

- Minimisation des données : ne collecter que ce qui est nécessaire

- Sécurité des traitements : protéger les données contre les fuites ou intrusions

- Durée limitée de conservation : ne pas garder indéfiniment les données, même pour entraîner des modèles

Ces obligations s’appliquent dès la phase de conception (principe de “privacy by design”) et tout au long du cycle de vie du système.

Analyse d'impact obligatoire dans certains cas

Si l’IA présente un risque élevé pour les droits et libertés des personnes, une analyse d’impact relative à la protection des données (AIPD) est obligatoire.

Exemples :

- Surveillance par caméra intelligente

- Analyse comportementale poussée

- Recrutement automatisé

- Détection de fraude avec profilage

Cette AIPD permet de documenter les risques, de proposer des mesures de réduction, et de démontrer la conformité en cas de contrôle.

Conclusion : le RGPD comme socle de l’IA responsable

Appliquer le RGPD dans les projets d’IA, ce n’est pas seulement cocher des cases juridiques. C’est poser des bases solides : respect des individus, maîtrise des risques, clarté dans les usages. Une IA conforme au RGPD est aussi une IA plus digne de confiance, mieux acceptée par les clients, et plus facile à faire évoluer sans accroc.

Pourquoi la gouvernance est cruciale pour limiter les risques

L’intégration de l’intelligence artificielle en entreprise ouvre la voie à de nombreux gains : productivité, précision, rapidité, personnalisation… Mais derrière cette promesse, un déploiement mal encadré peut exposer l’organisation à des risques concrets, parfois lourds de conséquences.

Sans gouvernance, l’IA devient un angle mort stratégique.

Risques juridiques : la non-conformité coûte cher

Le premier risque, c’est celui de l’illégalité.

Le RGPD impose des obligations strictes dès que des données personnelles sont en jeu. L’IA Act viendra encadrer encore plus finement les usages selon leur niveau de risque. En cas de non-conformité, les sanctions peuvent atteindre plusieurs millions d’euros, sans compter l’arrêt des projets ou leur interdiction de mise sur le marché.

Un système de recrutement automatisé, par exemple, qui discrimine indirectement certains profils ou manque de transparence, peut entraîner une sanction de la CNIL ou des litiges juridiques coûteux.

Risques réputationnels : la perte de confiance est immédiate

Une erreur d’algorithme, un biais non détecté, ou un traitement de données perçu comme intrusif peuvent saper la confiance des clients, des collaborateurs ou du public. Les crises réputationnelles liées à l’IA se multiplient : refus de prêts bancaires inexpliqués, surveillance abusive, deepfakes, biais dans les outils RH…

Dans un monde où la transparence est exigée, toute opacité algorithmique est un signal d’alerte. Une gouvernance claire permet d’anticiper ces incidents, de les détecter plus vite, et de montrer que l’entreprise agit de manière responsable.

Risques opérationnels : des modèles qui se retournent contre l’entreprise

L’absence de supervision et de contrôle peut conduire à des dérives ou à des décisions incohérentes, voire dangereuses. Une IA de maintenance prédictive mal calibrée peut déclencher des alertes inutiles. Un modèle d’analyse client entraîné sur des données biaisées peut écarter les bons profils. Et un système d’aide à la décision non surveillé peut dériver au fil du temps sans que personne ne s’en rende compte.

La gouvernance permet de maîtriser la chaîne de valeur de l’IA : de la qualité des données jusqu’à la performance réelle du modèle dans son contexte d’usage.

Risques internes : confusion des rôles et manque de pilotage

Sans gouvernance, les responsabilités sont floues : qui valide un cas d’usage IA ? Qui assure la conformité ? Qui gère les incidents ?

Cela crée des silos, des retards, et des frictions internes. Certaines équipes peuvent lancer des projets IA sans coordination, sans alignement avec les enjeux juridiques ou métiers. Résultat : un empilement de solutions non maîtrisées, difficile à maintenir, voire impossible à justifier.

La gouvernance permet de clarifier les rôles, structurer la prise de décision, et aligner les projets IA avec les objectifs globaux de l’entreprise.

Risques stratégiques : rater l’opportunité de créer de la valeur

Enfin, sans gouvernance, l’IA reste un gadget, une expérimentation sans lendemain, ou un outil sous-exploité. Gouverner l’IA, c’est aussi lui donner une direction, un cadre, une ambition. C’est assurer que les cas d’usage servent une vision stratégique, et que l’IA devient un levier de transformation durable, pas juste une expérimentation isolée.

A retenir : gouverner pour mieux innover

Face à ces risques, la gouvernance de l’IA n’est pas une option. C’est un filet de sécurité, mais aussi un accélérateur de confiance. En maîtrisant ce que fait l’IA, pour qui, comment, avec quelles données, et dans quel cadre, l’entreprise crée un environnement propice à l’innovation… sans se tirer une balle dans le pied.

Mettre en place une gouvernance de l’IA : étapes clés et outils

Mettre en place une gouvernance de l’IA ne se résume pas à écrire une charte ou désigner un référent. C’est une démarche structurée, qui doit s’inscrire dans la stratégie globale de l’entreprise et s’appuyer sur des outils concrets. Sans méthode ni pilotage, la gouvernance reste théorique et inefficace.

Voici les principales étapes à suivre pour passer à l’action.

Cartographier les usages d’IA dans l’entreprise

Première étape : savoir où l’IA est présente ou envisagée.

Cela passe par une cartographie des cas d’usage existants (recrutement, marketing, support client, finance, maintenance, etc.) et des projets en cours. On identifie les systèmes déjà déployés, ceux en test, et ceux prévus dans la feuille de route.

Cette cartographie permet de :

- Visualiser les zones à risque

- Prioriser les actions de mise en conformité

- Éviter les silos ou les redondances

Évaluer les risques et obligations légales

Chaque cas d’usage doit ensuite être analysé au regard des textes applicables : RGPD, IA Act, droit sectoriel, règles internes.

Questions à se poser :

- Le système traite-t-il des données personnelles ?

- Prend-il des décisions automatisées ayant un impact sur des individus ?

- Entre-t-il dans une des catégories à “haut risque” selon l’IA Act ?

- Un consentement est-il requis ?

- Faut-il faire une analyse d’impact ?

Cette évaluation permet d’anticiper les obligations et de dimensionner les efforts à fournir pour rester conforme.

Structurer la gouvernance : rôles, comités, processus

Il faut ensuite désigner les bons acteurs pour piloter la gouvernance de l’IA :

- Un sponsor stratégique (direction générale ou innovation)

- Un référent IA ou un comité de gouvernance transverse

- Le DPO, pour les aspects RGPD

- La direction juridique

- Les responsables métiers et techniques

L’objectif : sortir du flou, créer une dynamique transverse, et s’assurer que chaque projet IA est accompagné dès le départ par les bons interlocuteurs.

Documenter, superviser, tracer

Un système d’IA ne doit pas être une boîte noire. Chaque étape de sa vie (conception, entraînement, déploiement, évolution) doit être documentée :

- Origine des données

- Méthode d’entraînement

- Tests réalisés

- Niveau d’explicabilité

- Suivi des performances

- Plan de supervision humaine

Cette documentation est indispensable pour prouver la conformité en cas de contrôle, mais aussi pour gérer les évolutions et incidents.

S’équiper d’outils adaptés : le rôle clé de Synrune

C’est ici qu’intervient Synrune, une solution conçue pour simplifier et structurer la gouvernance de l’IA dans les entreprises.

Synrune agit comme un véritable cockpit IA :

- Il centralise la cartographie des usages IA de l’entreprise

- Il guide l’évaluation des risques en fonction des cadres légaux (RGPD, IA Act…)

- Il permet de documenter chaque système IA avec les éléments exigés par la réglementation

- Il assure une traçabilité complète des décisions, des validations et des évolutions

- Il facilite la collaboration entre les équipes tech, juridiques, métiers et data

- Et surtout, il automatise une partie des contrôles, pour ne rien laisser au hasard

Grâce à Synrune, la gouvernance ne repose plus sur des fichiers Excel dispersés ou des procédures manuelles, mais sur un environnement centralisé, dynamique, et actionnable.

C’est un accélérateur de conformité, mais aussi un levier de pilotage stratégique de l’IA dans l’entreprise.

Faire vivre la gouvernance dans la durée

Enfin, la gouvernance de l’IA ne s’arrête pas une fois les règles posées. Elle doit s’inscrire dans le temps :

- Suivi régulier des IA en production

- Mise à jour des documents et des analyses d’impact

- Veille réglementaire

- Sensibilisation continue des équipes

- Intégration de la gouvernance dans les processus de validation projets

La gouvernance doit devenir un réflexe, pas un exercice ponctuel.

Qui sont les acteurs clés à mobiliser en interne ?

Mettre en place une gouvernance de l’IA ne peut pas reposer sur une seule personne ou une seule équipe. C’est un effort collectif, qui nécessite de faire travailler ensemble des profils très différents : tech, juridique, métier, data, conformité… chacun ayant une pièce du puzzle.

Ce n’est qu’en croisant les expertises que l’entreprise peut maîtriser à la fois les enjeux techniques, éthiques, réglementaires et stratégiques liés à l’IA.

Voici les rôles essentiels à mobiliser.

La direction générale : le sponsor stratégique

Sans impulsion claire du top management, la gouvernance reste au stade de l’intention. La direction doit :

- Donner le signal politique que l’IA sera encadrée

- Intégrer la gouvernance IA dans les priorités stratégiques

- Nommer des référents et allouer des ressources

- Suivre les indicateurs liés à la maturité IA et à la conformité

Ce sponsoring permet de légitimer la démarche et de briser les silos entre services.

La direction juridique : cadre légal et veille réglementaire

Les juristes ont un rôle central pour :

- Traduire les exigences du RGPD et de l’IA Act en obligations concrètes

- Identifier les cas où une analyse d’impact est nécessaire

- Valider les contrats liés à des IA tierces

- Gérer les risques liés aux biais, aux décisions automatisées, à la transparence

Ils sont garants de la conformité, mais doivent aussi être proactifs et pédagogues dans leur approche.

Le DPO (Délégué à la protection des données)

Le DPO est l’interlocuteur clé pour toutes les questions relatives aux données personnelles :

- Il s’assure que l’IA respecte les principes du RGPD

- Il participe aux AIPD (analyses d’impact)

- Il sensibilise les équipes aux bonnes pratiques

- Il est le point de contact avec la CNIL en cas de contrôle ou de plainte

Son rôle est de prévenir les dérives, sans bloquer l’innovation.

Les équipes data et IA : conception, documentation, robustesse

Les data scientists, ingénieurs IA et data engineers sont évidemment au cœur de l’opérationnel. Mais pour une gouvernance solide, leur mission dépasse la performance du modèle :

- Ils doivent documenter les algorithmes, les données d’entraînement, les tests

- Travailler sur l’explicabilité, la robustesse, la détection de biais

- Collaborer avec les métiers et les juristes dès la conception

- Mettre en place des mécanismes de supervision

Ils ont un rôle technique et éthique, car c’est souvent d’eux que dépend la qualité intrinsèque du système.

Les métiers : porteurs de cas d’usage et garants de l’impact réel

Ce sont eux qui connaissent le terrain, les clients, les risques métiers. Ils doivent :

- Définir les besoins

- Valider que le système répond à une finalité claire

- Être impliqués dans les tests et l’évaluation des performances

- Détecter les effets inattendus ou les dérives en production

Sans eux, l’IA peut être déconnectée des usages réels — voire contre-productive.

Les équipes IT : sécurité, intégration, supervision

Les responsables IT garantissent la sécurité, la disponibilité et la maintenabilité des systèmes :

- Intégration dans l’infrastructure

- Respect des politiques de sécurité

- Suivi en production

- Journalisation et alertes

Ils sont aussi les garants de la résilience des systèmes IA sur la durée.

Un référent ou un comité de gouvernance IA

Pour coordonner tout cela, il est utile de désigner :

- Un référent IA (ou responsable de la conformité IA)

- Ou de mettre en place un comité de gouvernance IA transverse, avec des représentants de chaque direction

Ce rôle centralise l’information, assure le suivi des projets, pilote les outils (comme Synrune), et veille à ce que chaque nouveau cas d’usage passe par un circuit clair.

A retenir : pas de gouvernance sans collaboration

La gouvernance de l’IA repose sur une orchestration collective. Il ne suffit pas d’avoir les bons outils : encore faut-il mobiliser les bonnes personnes, au bon moment. En créant une culture de dialogue entre tech, droit et métiers, l’entreprise fait de la gouvernance un réflexe, pas une contrainte.

Conclusion – Gouverner l’IA, un levier stratégique pour innover durablement

L’intelligence artificielle est en train de redessiner les modèles d’affaires, les chaînes de valeur et les attentes des clients. Pour les entreprises, il ne s’agit plus de savoir si elles vont intégrer l’IA, mais comment le faire de manière efficace, éthique et conforme.

C’est là que la gouvernance de l’IA prend tout son sens.

Gouverner l’IA, ce n’est pas brider l’innovation. C’est lui donner un cadre clair, pour qu’elle serve des objectifs utiles, dans un climat de confiance, et dans le respect des droits. Une IA non maîtrisée est un risque. Une IA bien gouvernée devient un atout.

Les entreprises qui prennent le sujet au sérieux dès maintenant seront mieux préparées à :

- répondre aux exigences réglementaires (RGPD, IA Act),

- éviter les erreurs coûteuses (juridiques, réputationnelles, opérationnelles),

- renforcer la confiance de leurs clients, de leurs collaborateurs et de leurs partenaires,

- et faire de l’IA un vrai levier de compétitivité durable, pas juste une expérimentation isolée.

Des outils comme Synrune, qui structurent la gouvernance et facilitent la mise en conformité, permettent de passer d’une approche réactive à une démarche proactive. L’enjeu n’est pas seulement de “se mettre en règle”, mais de piloter l’IA comme un actif stratégique.

L’IA peut transformer profondément une organisation — à condition d’être bien encadrée, bien comprise, et bien pilotée. La gouvernance n’est pas un luxe : c’est la condition d’une innovation pérenne.